ポッドキャストアプリ、自動生成チャプター画像で不適切表示──コンテンツ管理の新たな課題

AI技術の活用が進む音声配信市場において、ポッドキャストアプリで自動生成されたチャプター画像に不適切な内容が含まれる問題が報告されました。この事象は、コンテンツの安全性、自動化技術の信頼性、およびプラットフォームの責任に関する議論を提起しています。

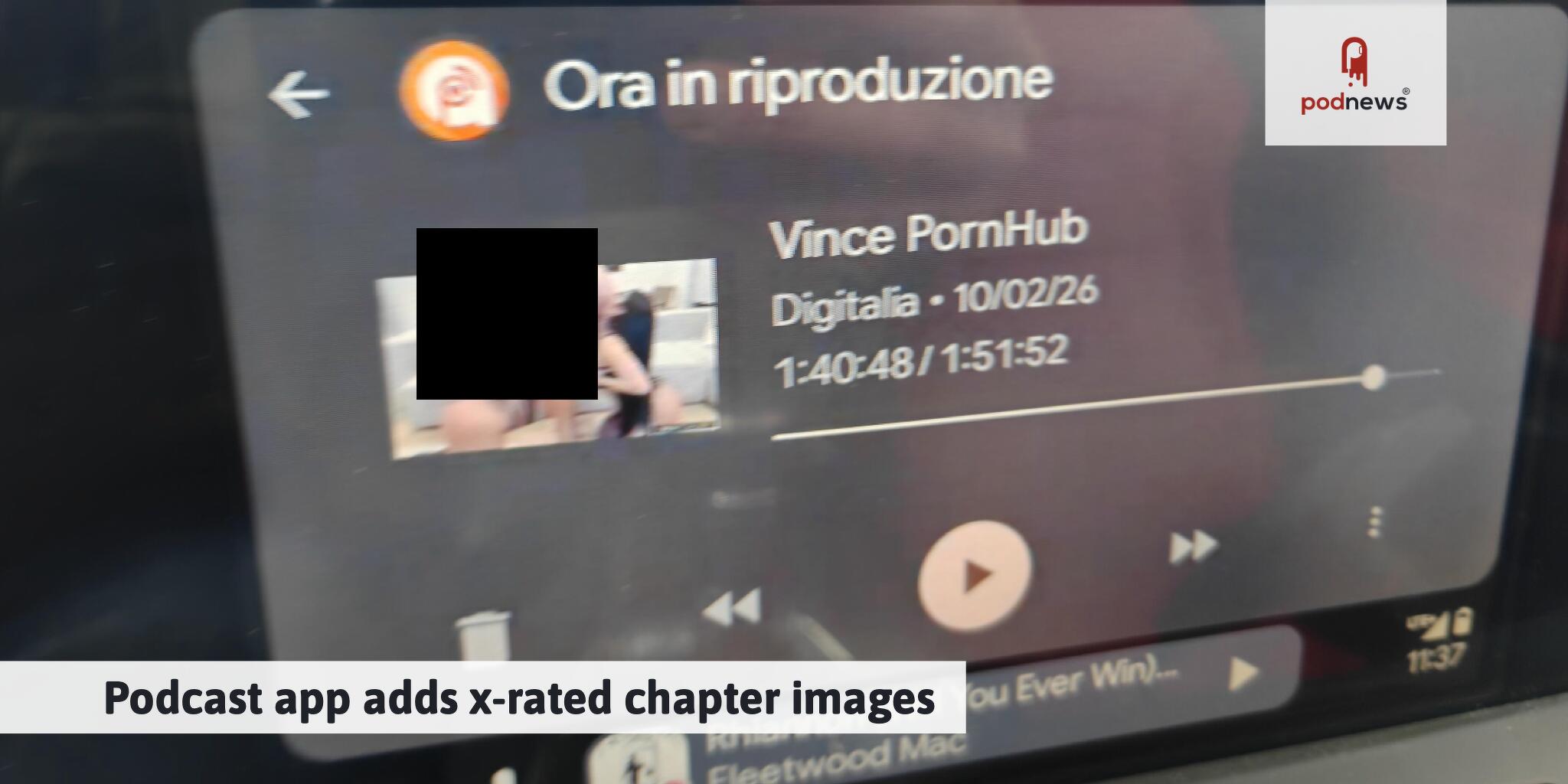

特に、自動車内でのポッドキャスト再生時に同乗者に不快感を与える可能性が指摘されており、ユーザー体験への影響が懸念されています。本件は、AIが生成するコンテンツの品質管理と倫理的側面が、今後の音声配信業界の発展において不可欠であることを示唆しています。

ポッドキャストアプリにおけるチャプター画像問題の概要

Podnewsの報告によると、一部のポッドキャストアプリにおいて、自動生成されるチャプター画像に不適切なコンテンツが含まれる事例が確認されました。この機能は、ポッドキャストのオーディオコンテンツをAIが解析し、視覚的な要素としてチャプター画像を自動で表示するものです。これにより、リスナーのエンゲージメント向上を目的として導入されたと見られます。

しかし、AIのコンテンツ認識能力やフィルタリング機能の不完全さが露呈し、意図しない画像が表示される結果となりました。この問題は、AIの倫理的利用と技術的限界が交錯する点として、業界内で注目されています。

| 項目 | 内容 |

|---|---|

| 発表内容 | ポッドキャストアプリにおけるチャプター画像の不適切表示 |

| ソース | Podnews |

| 概要 | AIによる自動生成画像に不適切なコンテンツが含まれ、特に自動車内での再生時に問題が発生 |

| 技術的背景 | AIによる音声解析に基づく画像生成(推測) |

| 影響 | ユーザーの不快感、プラットフォーム信頼性低下、コンテンツ管理の課題 |

Podcast app adds x-rated chapter images

Podnewsが2026年2月18日に報じた記事「Podcast app adds x-rated chapter images」は、ポッドキャストアプリが自動生成するチャプター画像に不適切な内容が含まれた事例を詳細に伝えています。この問題は、特に自動車内でのポッドキャスト再生中に発生し、同乗者に困惑を与える可能性が指摘されています。

記事によれば、この現象は特定のポッドキャストアプリやプラットフォームに限定されるものではなく、ポッドキャストのメタデータやコンテンツ内容をAIが解析し、視覚的なチャプター画像を自動生成する機能が背景にあると見られます。この技術は、リスナーエンゲージメントの向上を目的として導入されたものですが、AIのコンテンツ認識精度やフィルタリング機能に課題があることが明らかになりました。

具体的な技術仕様については記事内で詳細が示されていないものの、音声コンテンツのキーワード抽出や文脈解析に基づき、関連性の高い画像をインターネット上から取得、または生成していると推測されます。2025年時点での世界のポッドキャスト市場規模は、Statistaの予測に基づくと約400億ドルに達し、年平均成長率(CAGR)は15%以上で推移していると見られます。リスナー数も増加傾向にあり、このような成長市場においてコンテンツの安全性と信頼性はプラットフォームの持続可能性を左右する重要な要素です。

類似の自動生成コンテンツにおける不適切表示は、過去にもテキスト生成AIや画像生成AIの分野で報告されており、技術開発と並行した厳格なコンテンツモデレーション体制の構築が不可欠であることが示されています。本件は、AIを活用したコンテンツ提供における倫理的課題と技術的限界を浮き彫りにする事例として認識されています。

音声配信市場におけるAI利用とコンテンツ管理の課題

2026年時点の世界の音声配信市場は、AI技術の導入によりコンテンツ制作から配信、リスナー分析に至るまで多様な変革期を迎えています。市場規模は引き続き拡大傾向にあり、主要プレイヤーであるSpotify、Apple Podcasts、Google Podcasts、Amazon Musicなどが、AIを活用したパーソナライゼーションやコンテンツ推薦機能を強化しています。

しかし、AIによる自動生成コンテンツの問題は、プラットフォーム側のコンテンツモデレーションにおける新たな課題を提示しています。過去には、YouTubeの自動字幕生成における誤認識や、SNSプラットフォームのAIモデレーションにおける不適切コンテンツの検知漏れなどが報告されています。

| サービスカテゴリ | AI利用目的 | 主な課題 | 対策状況 |

|---|---|---|---|

| ポッドキャストアプリ | チャプター画像自動生成 | 不適切画像の表示 | フィルタリング強化が急務 |

| 動画プラットフォーム | 自動字幕生成 | 誤認識、文脈齟齬 | ユーザー報告、手動修正併用 |

| SNSプラットフォーム | コンテンツモデレーション | 不適切コンテンツの検知漏れ | AIモデル改善、人手監視 |

| 画像生成AI | 画像生成 | 適切な、倫理的問題 | 倫理ガイドライン、フィルタリング |

今回のポッドキャストアプリにおける問題は、AIによる自動化がもたらす効率性や利便性という「強み」の裏側で、AIの誤認識やフィルタリングの限界という「弱み」が顕在化したものです。これにより、ユーザー信頼の喪失や法的規制の強化という「脅威」に直面する可能性がありますが、技術改善によるユーザー体験向上という「機会」も存在します。音声配信業界は、コンテンツモデレーション、自然言語処理(NLP)、コンピュータビジョン、AI倫理といった専門分野の知見を統合し、AIガバナンスを確立することが求められます。

音声配信業界におけるAIガバナンスと規制動向

ポッドキャストアプリにおけるチャプター画像の不適切表示問題は、音声配信業界の今後の展開に影響を与える可能性があります。短期(6ヶ月以内)では、ポッドキャストプラットフォームは自動生成機能に対するフィルタリング強化やユーザー報告システムの改善を優先的に実施すると予測されます。一部のプラットフォームでは、AIによるチャプター画像生成機能の一時停止やオプション化が進む可能性も存在します。

中期(1-2年)では、AIモデルの精度向上と業界全体での倫理ガイドライン策定が進行すると見られます。EUのAI規制法案(AI Act)など、国際的なAI規制の動向がプラットフォームのコンテンツ管理方針に影響を与え、より厳格なコンプライアンス体制が求められると予測されます。これにより、コンテンツの安全性に対する投資が増加する可能性があります。

長期(3-5年)では、AIを活用したコンテンツ生成・管理技術は進化を続けるものの、人間による監視とAIの協調(Human-in-the-Loop)が標準的な運用モデルとして確立される可能性があります。技術的リスク、法的リスク、競合リスク、市場リスク、ブランドリスク、規制リスクといった多角的なリスク要因が存在し、特に法的・ブランドリスクは一度発生すると回復が困難であるため、プラットフォームは早期の対策が急務であると評価されます。

参考文献

- Podnews. (2026, February 18). Podcast app adds x-rated chapter images. https://podnews.net/update/naughty-pictures

免責事項:本記事は、公開された情報に基づき作成されたものであり、その内容の完全性、正確性、信頼性を期待するものではありません。記載されている見解は執筆時点のものであり、市場状況や法規制の変更により変動する可能性があります。投資判断やビジネス上の意思決定を行う際には、多くの場合専門家にご相談ください。